- 长臂猿-企业应用及系统软件平台

机器之心报道 编辑:张倩、佳琪

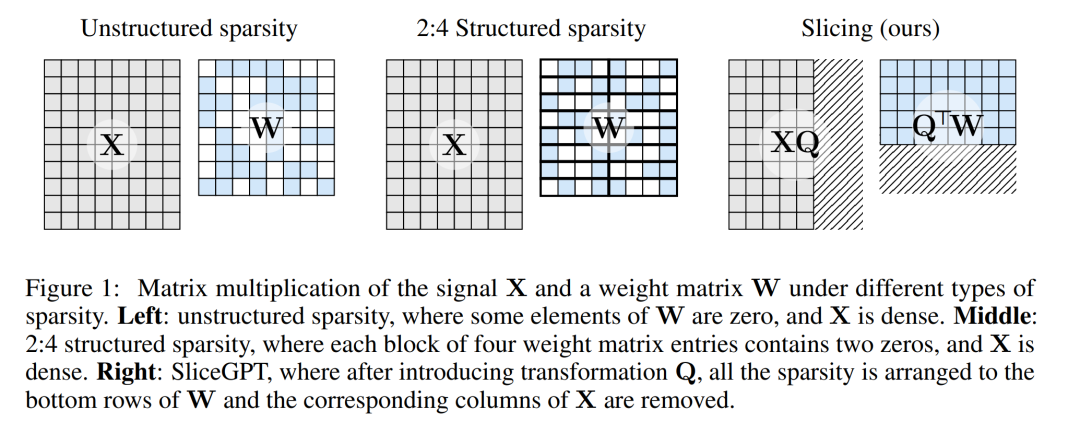

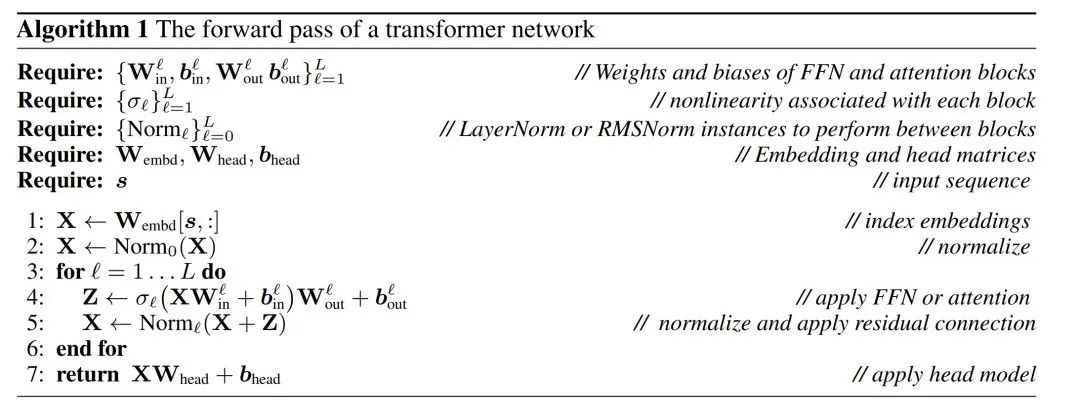

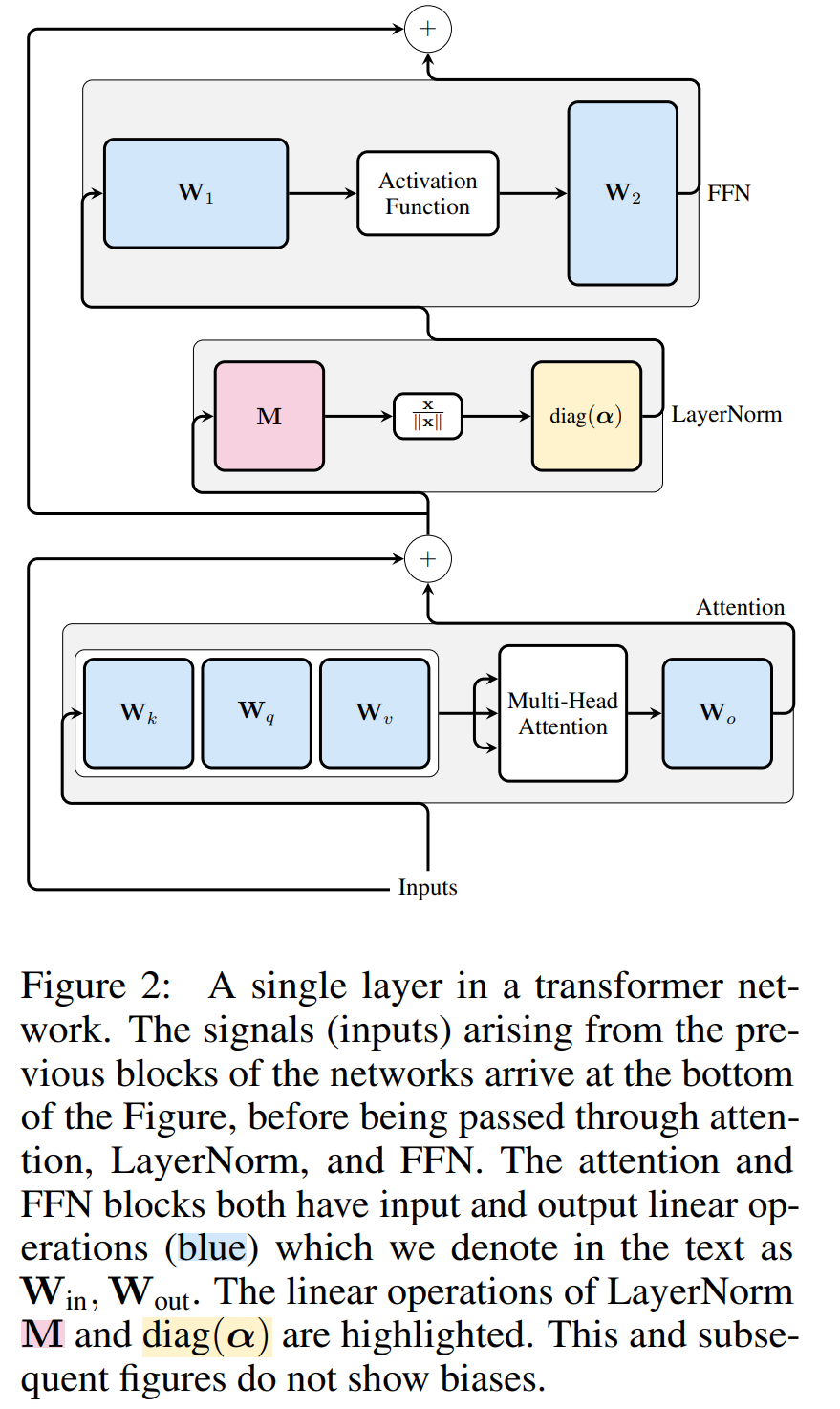

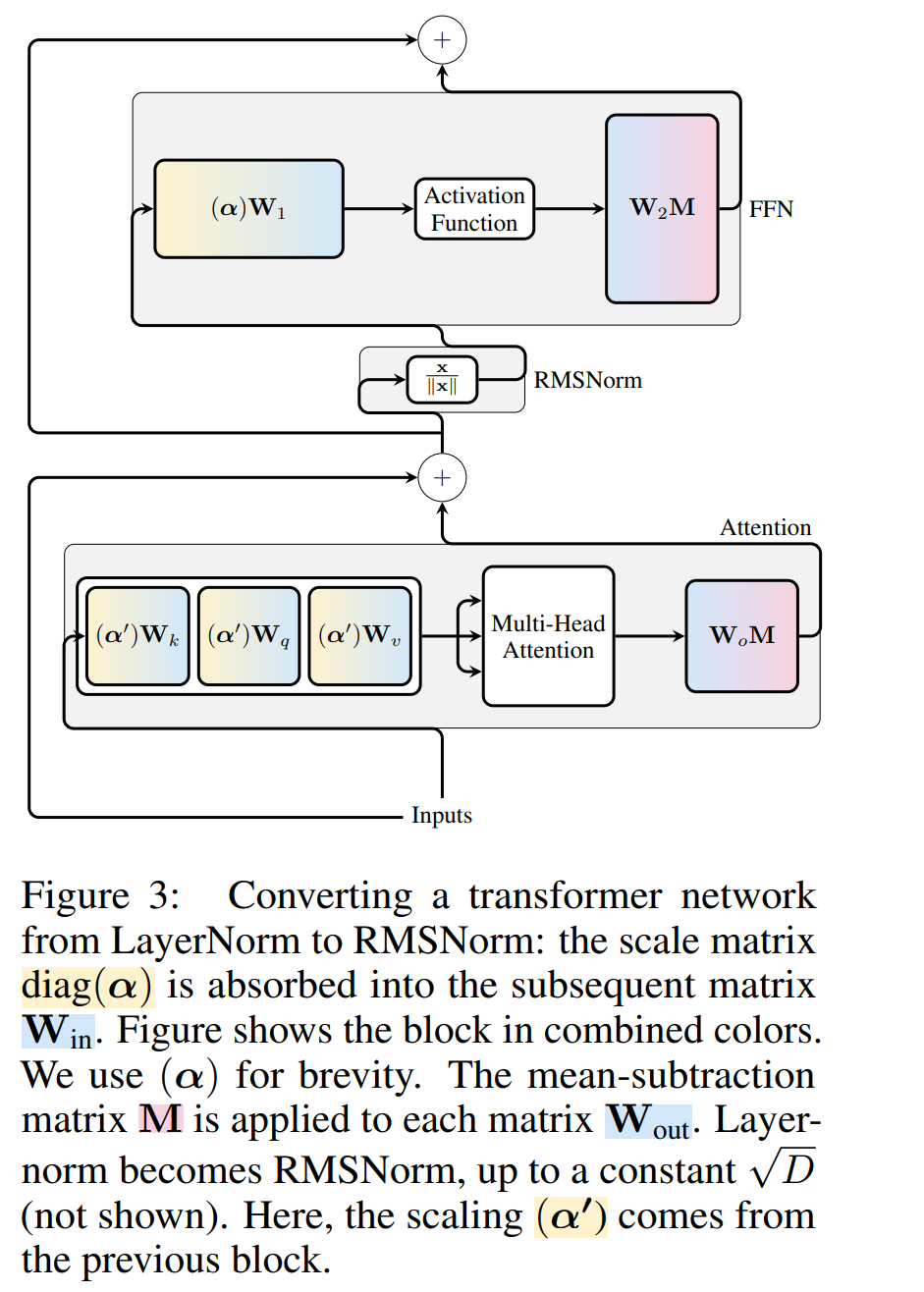

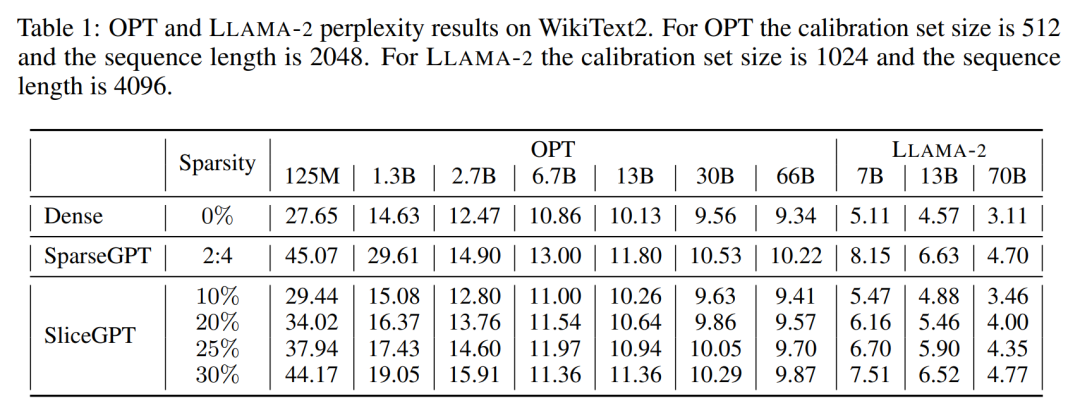

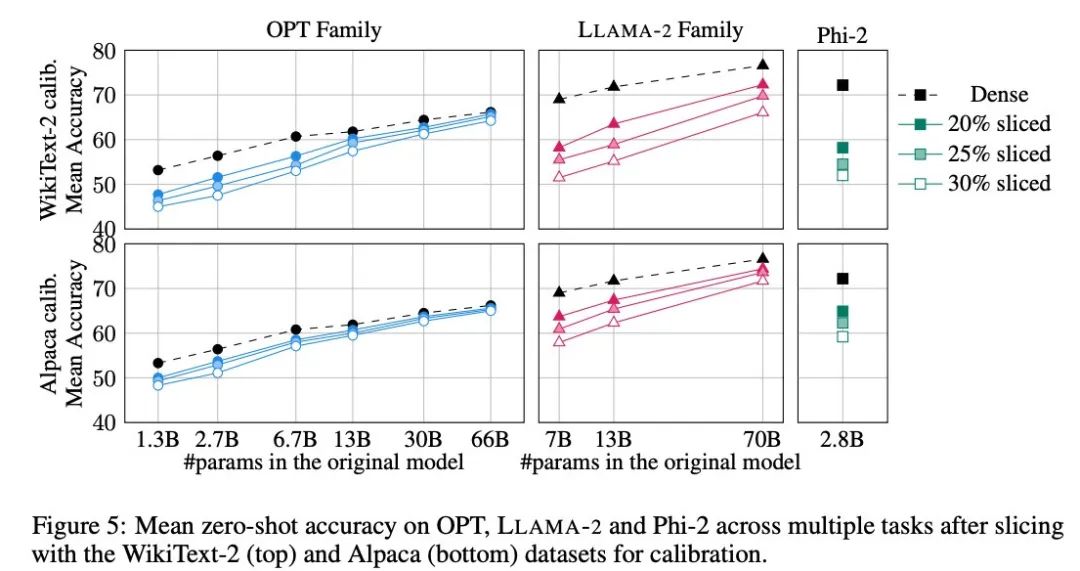

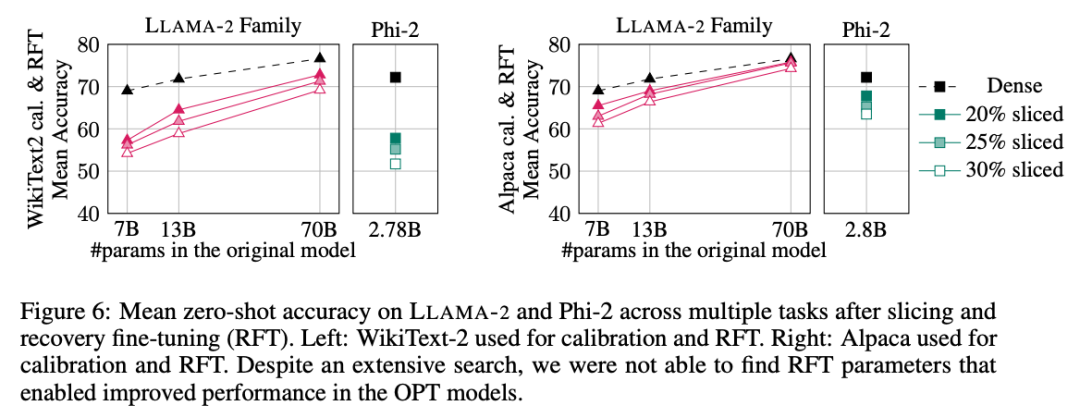

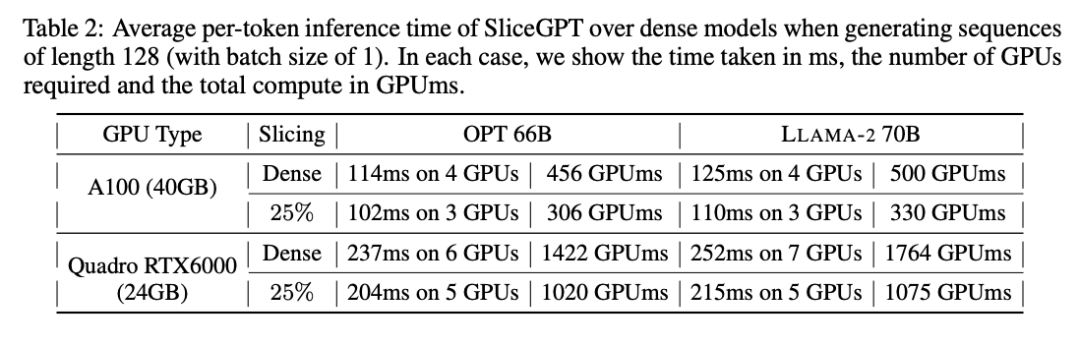

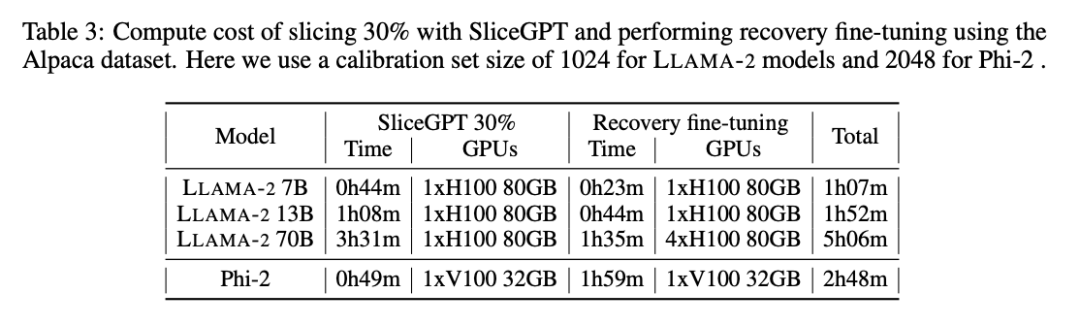

删除权重矩阵的一些行和列,让 LLAMA-2 70B 的参数量减少 25%,模型还能保持 99% 的零样本任务性能,同时计算效率大大提升。这就是微软 SliceGPT 的威力。

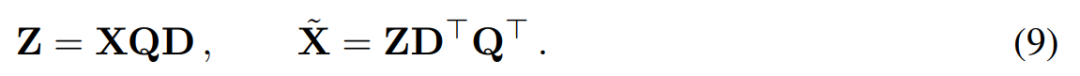

和

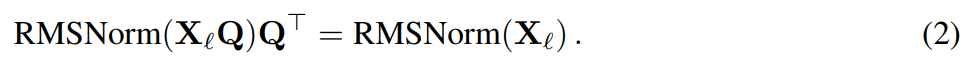

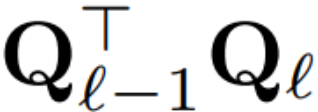

和 为 RMSNorm 连接的 transformer 网络第 ℓ 块线性层的权重矩阵,

为 RMSNorm 连接的 transformer 网络第 ℓ 块线性层的权重矩阵, 、

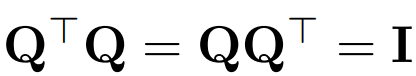

、 为相应的偏置(如果有),W_embd 和 W_head 为嵌入矩阵和头矩阵。设 Q 是维数为 D 的正交矩阵,那么下面的网络就等同于原来的 transformer 网络:

为相应的偏置(如果有),W_embd 和 W_head 为嵌入矩阵和头矩阵。设 Q 是维数为 D 的正交矩阵,那么下面的网络就等同于原来的 transformer 网络:

来修改残差连接。

来修改残差连接。

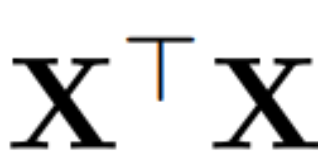

他们使用转换后网络的输出来计算下一层的正交矩阵。更确切地说,如果

他们使用转换后网络的输出来计算下一层的正交矩阵。更确切地说,如果  是校准数据集中第 i 个序列的第 ℓ 个 RMSNorm 模块的输出,计算:

是校准数据集中第 i 个序列的第 ℓ 个 RMSNorm 模块的输出,计算:

:

:

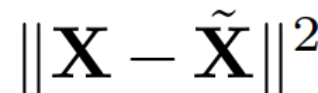

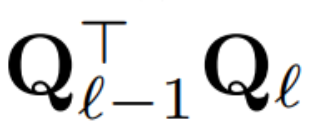

的特征向量,D 是一个 D × D 小删除矩阵(包含 D × D 同位矩阵的 D 小列),用于删除矩阵左边的一些列。从 QD 是最小化

的特征向量,D 是一个 D × D 小删除矩阵(包含 D × D 同位矩阵的 D 小列),用于删除矩阵左边的一些列。从 QD 是最小化  的线性映射的意义上来说,重建是 L_2 最佳(L_2 optimal)的。

的线性映射的意义上来说,重建是 L_2 最佳(L_2 optimal)的。 的行和列(见图 4)。

的行和列(见图 4)。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:content@jiqizhixin.com