- 长臂猿-企业应用及系统软件平台

2023年,几乎 AI 的每个领域都在以前所未有的速度进化,同时,AI也在不断地推动着具身智能、自动驾驶等关键赛道的技术边界。

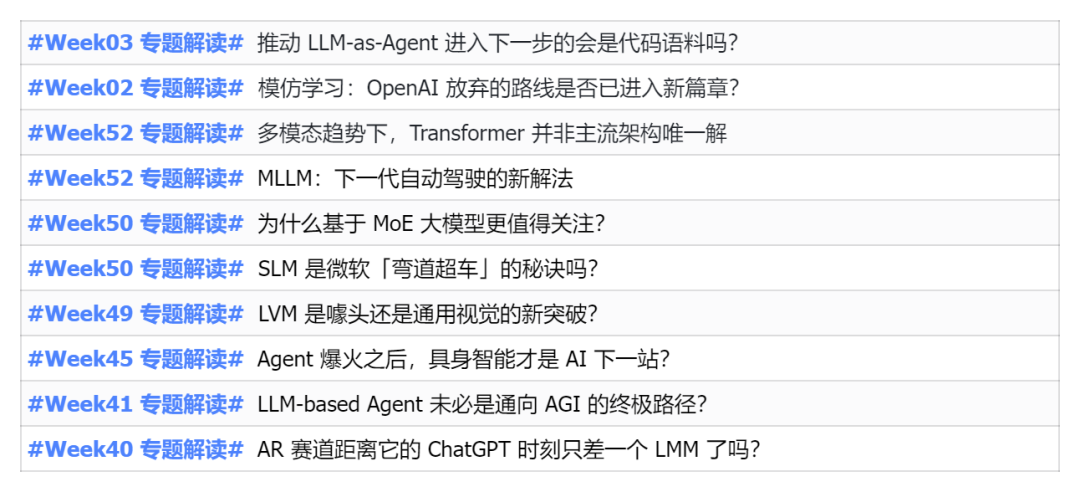

多模态趋势下,Transformer 作为 AI 大模型主流架构的局面是否会撼动?为何探索基于 MoE (专家混合)架构的大模型成为业内新趋势?大型视觉模型 (LVM)能否成为通用视觉的新突破?...

我们从过去的半年发布的2023年机器之心PRO会员通讯中,挑选了 10 份针对以上领域技术趋势、产业变革进行深入剖析的专题解读,助您在新的一年里为大展宏图做好准备。