仅有四人的初创公司,已经融资5500万美元,融资名单几乎集齐了硅谷的半壁江山,半年用户超50万,今天,Pika 1.0闪亮登场,电影级特效震撼全网。

文丨新智元 ID:AI_era

Runway Gen-2最强竞品Pika,暌违半年忽然放出大招——Pika 1.0正式发布!

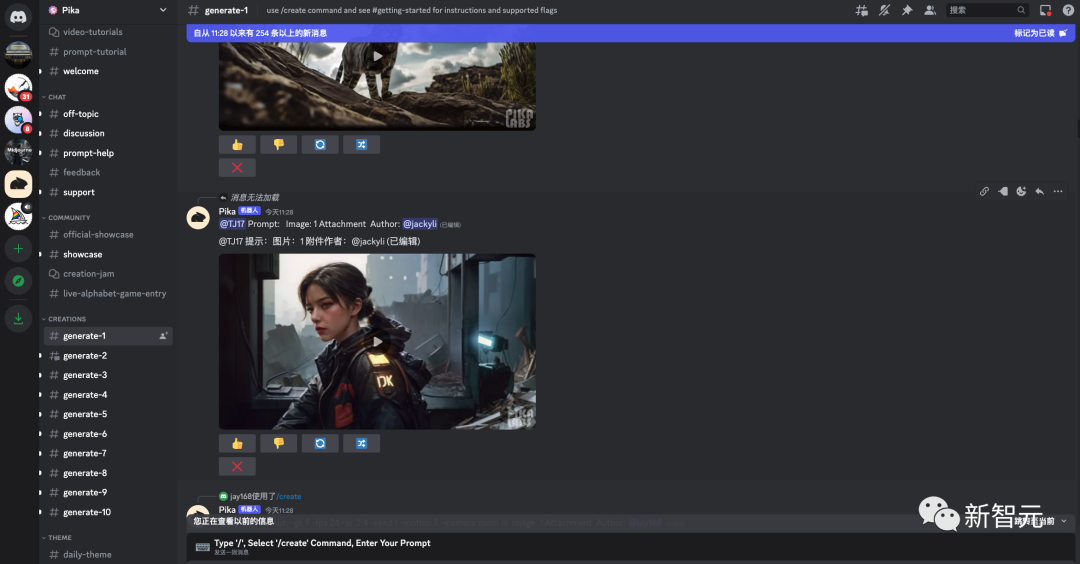

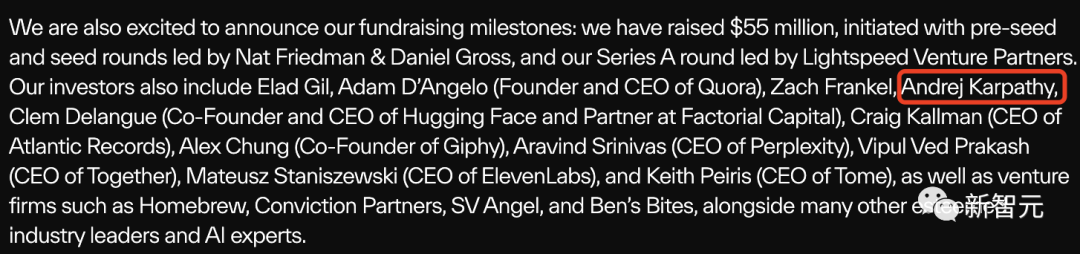

仅成立六个月,Pika就结束了测试版,正式发布了第一个产品,能够生成和编辑3D动画、动漫、卡通和电影。而且,Pika已经获得了5500万美元融资(估值近2亿美元),这使得这家仅有四人的初创公司,具备了和Meta、Adobe、Stability AI等巨头一搏的实力。一连串投资人名单非常豪华,几乎所有AI领域的知名公司都参与了此轮融资,名单包括但不限于——前Github CEO Nat Friedman、Quora创始人Adam D'Angelo、OpenAI创始成员Karpathy、Perplexity CEO等等,堪称是集齐了硅谷的半壁江山。而Pika的诞生,是又一个从斯坦福退学、成为CEO的故事——创始人郭文景(Demi Guo)和联合创始人兼CTO Chenlin Meng,都是斯坦福大学AI Lab博士生。Pika CEO Demi Guo(左)从小喜欢诗歌和创意写作,联合创始人兼首席技术官Chenlin Meng(右)希望成为一名动画师。机缘巧合,Pika的创立,竟还是竞品Runway提供的契机。郭文景和同学曾在去年参加Runway的首届AI电影节,发现Runway和Adobe Photoshop的工具并不好用,自己的作品也并未获奖。今年四月,郭文景决定从斯坦福退学,开发更好用的AI视频工具,Pika由此诞生。大佬们的天使投资只是可能成功的背书,而真正引起全网轰动的,还是它官方放出的效果视频:一句话,「elon musk in a space suit,3d animation」,马斯克瞬间进入二次元。炸裂的是,3D动画版的马老板不但神形兼备,而且背景和动作都非常合理连贯,面部一致性也惊人的完美!对比Gen-2和Pika Labs之前的视频效果,Pika 1.0简直不是一个时代的产品。观众也许还没从3D马斯克惊艳的效果中回过神来,下一段视频中官方马上秀出了Pika 1.0生成其他风格的视频效果。从普通的2D动画,到实拍感十足的电影场景,生成的视频呈现出了完美的光影,精致的细节,多样化的镜头控制。而真正引发全网欢呼的,是Pika Labs 1.0能够支持对于视频实时编辑和修改。这些连AI生图领域都才刚刚获得的能力,Pika Labs就能把它们扩展到AI视频中来。类似于Midjourney对于图片的「外画」功能,Pika 1.0可以根据已有的素材直接扩展视频,生成不同高宽比的内容。更为夸张的是,Pika 1.0可以直接在视频中添加想要的素材。只要用鼠标框一下,输入「一副酷酷的太阳镜」,马上就能给视频中的狒狒精确地带上墨镜,和原视频完美契合。而对于视频中人物的着装,也只要简单框一个范围,文字输入想要的效果,就能一键换装。支持三种模态的提示输入,让Pika Labs 1.0直接「对齐」了runway家族的几乎所有的功能。文生视频,所有人物,动物的面部表情都非常完美,加上好莱坞动画级别的细节和光影效果,很难想象这个公司成立仅仅半年。图片配合提示词生成动画,图片为第一帧,文字控制动画变化效果和镜头。而根据用户提供的视频素材,配合提示词来制作不同风格的动画,更是手到擒来。从像素风到到黑白幻灯片效果,演示出的5种风格转化,几乎涵盖了现有电影和动画大部分风格。总结一下,全新的模型Pika 1.0的新功能包括:- 文本生成视频/图像生成视频:输入几行文本或上传图像,就可以通过AI创建简短、高质量的视频。- 视频-视频不同风格转换:将现有视频转换为不同的风格,包括不同的角色和对象,同时保持视频的结构。- 扩展(expand):扩展视频的画布或宽高比。将视频从TikTok 9:16格式更改为宽屏16:9格式,AI模型将预测超出原始视频边界的内容。- 更改:使用 AI 编辑视频内容,比如更换衣服、添加另一个角色、更改环境或添加道具。- 扩展(Extend):使用 AI 扩展现有视频剪辑的长度。- 全新Web界面:Pika 将在https://pika.art的Discord和Web(移动和桌面)上提供。

从现在Pika Labs 1.0能实现的功能来看,两位创始人说他们因为觉得Runway不好用才来创业,看来是一点都不夸张。他们几乎是在6个月的时间里做出了Runway家族现有的所有功能,还针对Runway产品中现有的几大短板做了全面的升级。几乎完美的人物面部一致性,让动画中人物的脸部特征不会发生畸变。准确的提示词编辑能力,能让用户自由添加和修改视频中的各种元素。现在Pika 1.0开启了申请试用,网友看了视频之后发推感叹:排队申请Pika 1.0的人,现在是这样的!在获取Pika 1.0试用资格之前,和Midjourney一样,用户现在通过Discord获取Pika Labs的视频生成服务。用户只需在聊天框输入文字,比如「一个机器人在日落沙滩上行走」,就能收到一个由AI生成的视频。周二,Pika把这一体验带到了网页上,面向更广泛的主流群体,让他们可以在编辑视频、自定义物体。这里还有一段,Pika创意总监前几天放出的,用Pika文本转视频AI功能制作的「3D动画预告片」,效果萌到爆。加密领域的大牛们盛赞了Pika 1.0,包括Solana的联合创始人,以及Reddit的联合创始人Alexis Ohanian。加密社区中的许多人认为,生成式AI可以振兴NFT市场,为创作者提供新方法,将他们的数字愿景变为现实,并为收藏家提供独特的AI制作数字资产。作为Pika Labs的天使投资人,Hugging Face CEO Clement昨天也做出了预言:2024年,某个主流媒体领域将会充斥AI生成的内容。OpenAI科学家Karpathy本人是非常关注图像-视频生成领域的新动向。并且也在Pika Labs的本轮融资中参投。你知道图像生成是如何在极短时间内,从模糊的32x32纹理块,变成难以在与真实图像区分的高分辨率图像的吗?现在,同样的事情正在同时间发生,已经延伸到视频,其影响令人难以置信。每个人都成为多模态梦想的导演,就像《盗梦空间》中的建筑师一样。暂时回到现实,图像/视频生成与数据饥渴的神经网络完美匹配。因为数据丰富,每个图像或视频的像素是网络参数的巨大比特(软约束)来源。当你在数据监督的环境中训练巨型神经网络时,你的训练损失=验证损失,生活是多么美好。

两个月前,他还曾联动使用DALL·E 3和Pika Labs的工具生成了一个动画。Perplexity AI的首席执行官表示,Demi和Chenlin充满干劲。这就是为什么她们会大获成功的原因。从我参与他们的种子轮融资开始观察他们的执行力和进度,让我意识到一件事:保持不懈的干劲。Stability AI的首席执行官对Pika Labs的最新成果也是赞不绝口。Pytorch的CEO表示,Runway作为该领域的佼佼者,现在有了新的竞争对手。根据福布斯的报道,去年冬天,郭文景和同几位斯坦福的计算机博士同学一起,打算利用寒假的时间,用生成式AI制作一部电影。当时,估值已达5亿美元的初创公司Runway,举办了首届AI电影节,奖金高达10,000美元。而他们对获奖很有信心。出乎意料的是,郭文景团队的作品并没有入选。他们的团队技术含量很高,但制作电影的过程并不顺利。虽然当时AI技术有了许多突破,但将它们应用于视频制作的过程十分繁琐 。即便团队在Gen-2和Adobe Photoshop上投入了大量的时间,效果却并不理想。最终,Runway的大奖颁发给了专业的创意团队。这让郭文景很沮丧。今年四月,郭文景和Chenlin Meng从斯坦福辍学,创办了Pika,目的是构建更易使用的的AI视频生成工具。Pika成立后,到现在为止已经有了50万用户,他们每周都会制作数百万个视频。这种爆炸式增长,引起了硅谷投资人的兴趣,让Pika在三轮融资中筹集到了5500万美元。前两轮融资由前 GitHub 首席执行官CEO Nat Friedman领投,而最新一轮的3500万美元A轮融资由Lightspeed Venture Partners领投。Friedman表示,自己对Pika团队使用单GPU就制作出的初期demo,印象非常深刻。Friedman与投资人Daniel Gross共同拥有一个包含2500多个GPU的超级计算集群,名为Andromeda(仙女座)。他们投资的初创公司,都会得到这个资源的支持。得到仙女座超算集群的助力,Pika的AI视频模型飞速地进步。因为她们觉得,用AI生成真实视频的任务过于艰巨,像Runway和Stability AI资金雄厚的公司已经有了领先优势。而且,Adobe这样的巨头,也迅速把AI功能集成到了产品中。一个夏日的下午,天使投资人Friedman向团队提出了一个想法:在视频中嵌入文本。凌晨3点,他收到了一条短信,告知这项功能已经准备就绪。团队如此高效,让Friedman非常震惊,但他很快就意识到:这种「极端高效」的工作节奏,正是这个团队最大的特色。而这,也正是Friedman决定进行下一轮投资的原因之一。九月投资的Lightspeed的合伙人Michael Mignano,同样认为这是Pika的关键优势:「对于初创公司来说,速度就是最大的武器和优势,而这个团队,无疑是我见过最快的。」就是靠着这样的速度,短短几周,团队就实现了用AI制作真实视频。而当Mignano在11月初提出开发网页应用的想法时,Pika立即行动,在当月就推出了网页版。现在,Pika租用了几百个GPU。今天发布的Pika 1.0,正是基于这些GPU构建的。同时,Pika团队也在努力改进他们的算法以增强模型性能,并开发新算法来过滤掉可能引发版权诉讼的、受版权保护的内容。随着新一轮资金的到位,郭计划在明年将Pika的团队扩展到大约20人,大部分是工程师和研究人员。目前Pika的产品还是免费的,他们也不着急赚钱,但郭文景表示公司可能最终会推出分层订阅模式,让付费用户享用更多功能。郭文景还计划通过这种方式,让Pika与其他竞品区分开。我们开发的并不是电影制作工具,而是为日常消费者打造的产品——我们虽然有创造力,但并不是专业人士。如果在一年前,就有Pika这样的工具,那我们团队在AI电影节上,很可能会大放异彩。

科技巨头Adobe Systems收购了Rephrase.ai,Meta推出了Emu Video,Stability AI 发布了Stable Video Diffusion,Runway对RunwayML进行了更新。而Pika的闯入,无疑再次搅动了AI视频领域的格局,战场上已经硝烟滚滚。参考资料:

https://twitter.com/pika_labs/status/1729510078959497562

https://techcrunch.com/2023/11/28/pika-labs-which-is-building-ai-tools-to-generate-and-edit-videos-raises-55m/

https://decrypt.co/207799/pika-ai-video-tool-blasts-out-of-beta(首图来源:图虫;正文中配图来源:新智元)