专注AIGC领域的专业社区,关注OpenAI、百度文心一言等大语言模型(LLM)的发展和应用落地,关注LLM的基准评测和市场研究,欢迎关注!

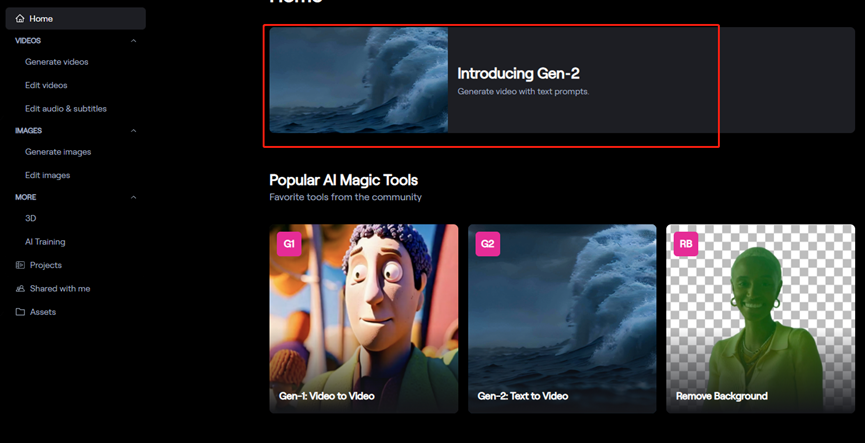

近日,多模态生成式AI平台Runway宣布,旗下文本生成视频平台Gen-2正式公测。(免费体验地址:https://runwayml.com/ai-magic-tools/gen-2/)早在今年3月份Runway就已经发布了Gen-2,但仅限于申请测试,不过仍受到了全球用户、媒体的极大关注。Gen-2与Gen-1相比功能强大、特效酷炫,支持文本生成视频、文本+图片生成视频、图片生成视频、视频风格化等操作。「AIGC开放社区」体验了一下Gen-2,其生成的视频对于普通人来说,无需使用AE、Blender等专业软件就能轻松实现酷炫特效。但用专业视角来看,存在模糊、颗粒感较重、光线穿透差、帧率不稳定、视频动物/人物的动作诡异等问题。所以,用Gen-2制作惊悚电影效果出奇的好,视频的元素变化多端根本无法预测,会让你产生一种浓厚的自然恐怖氛围,可以制作像《猛鬼街》、《鬼娃新娘》、《寂静岭》那样的好莱坞恐怖大片。下面这个恐怖视频是用Gen-2制作的,与人脸融合的狗头,走走路突然变成动物的人,整个视频散发着毫无违和感的恐怖效果,仿佛这些生物真的存在。

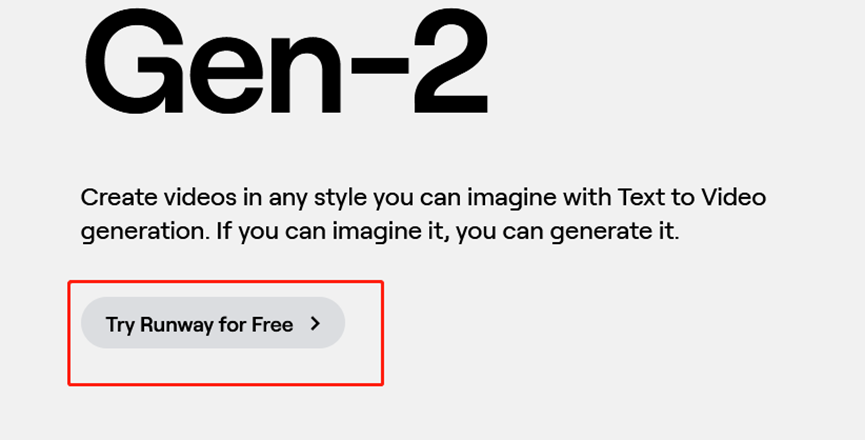

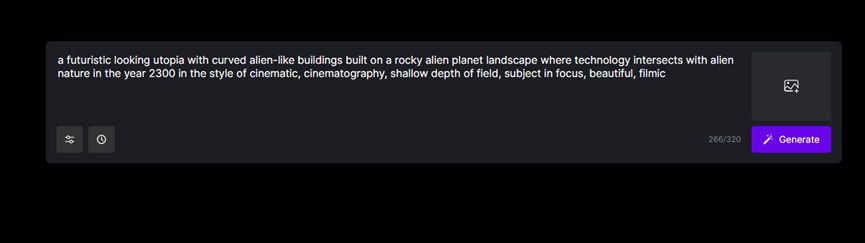

Runway在文本生成视频领域的竞争对手很多,但凭借Gen-1、Gen-2等一系列优质AIGC产品,在今年6月3日获得了谷歌参投的1亿美元D轮融资估值达到15亿美元,成为该领域的独角兽。Gen-2是Runway在今年3月最新发布的,可以通过文本、图片、文本+图片直接生成视频,同时支持风格化和渲染添加好莱坞式大片特效,仅需要几分钟即可完成所有操作。据Runway介绍,Gen-2采用的是扩散模型,生成的过程从完全由噪声构成的起始图像中逐渐消除噪声,以接近用户的文本提示。Gen-2的训练数据包括2.4亿张图片、640万个视频剪辑片段以及数亿个学习示例。不过Gen-2输出的视频内容可能会存在偏见、歧视。例如,生成一名身穿西装的CEO正在会议室开会,通常主角都是白人,很少出现黑人或亚洲人。Gen-2的使用流程非常简单和Midjourney类似,需要制定特定场景、背景、角度、主角等元素,例如,一个水下乌托邦的视频,一名男人正在拼命的挣扎,用旧相机拍摄,恐怖电影风格。也可以直接上传图片生成视频。1)在https://runwayml.com/ai-magic-tools/gen-2/选择【Try Runway for Free】免费注册登录到Runway平台。3)输入文字进行制作,目前Gen-2限制320个字符。例如,一个未来的乌托邦时代,有弯曲的外星人般的建筑,建在岩石般的外星景观上,2300年,电影风格,电影摄影,浅景深,聚焦主题,美丽。总体来说,Gen-2处于产品打磨阶段,无法达到抢专业视频制作者饭碗的地步。毕竟视频生成比文本、图片更加复杂难以控制。相信经过多次技术迭代和全球用户的深度反馈后,会达到ChatGPT、Midjourney那样的效果。本文素材来源Gen-2官网,如有侵权请联系删除

END